(TAP) - Sự bùng nổ công nghệ trí tuệ nhân tạo (AI) kéo theo sự xuất hiện ngày càng tinh vi của deepfake, đặc biệt là giọng nói nhân tạo. Trước thách thức này, nhóm nghiên cứu từ Tổ chức Nghiên cứu Khoa học và Công nghiệp Liên bang Úc (CSIRO) giới thiệu phương pháp RAIS, giúp phát hiện âm thanh giả mạo và duy trì hiệu quả ngay cả khi kỹ thuật deepfake tiếp tục phát triển.

Theo thông tin đăng tải trên trang CSIRO, ngày 11/11 vừa qua, những nhà nghiên cứu từ CSIRO, Đại học Federation Australia và Đại học RMIT đã giới thiệu một phương pháp mới mang tên Rehearsal with Auxiliary-Informed Sampling (RAIS). Đây chính là bước tiến quan trọng trong việc phát hiện, ngăn chặn bản ghi âm giả mạo tinh vi nhờ deepfake. Deepfake là công nghệ sử dụng AI để tạo hoặc chỉnh sửa nội dung hình ảnh, video, âm thanh, khiến chúng trông (nghe) giống thật đến mức khó phân biệt bằng mắt thường hay tai người. Tuy nhiên, ngày nay deepfake đang dần trở thành công cụ cho nhiều nhóm tội phạm mạng lợi dụng để vượt qua hệ thống xác thực bằng giọng nói, giả mạo danh tính, phát tán thông tin sai lệch.

Công bố được đăng trên trang của CSIRO. Nguồn: csrio.

Theo nhóm nghiên cứu, RAIS được thiết kế nhằm xác định tính thật giả của đoạn âm thanh, đồng thời có khả năng duy trì hiệu suất lâu dài khi các kỹ thuật tấn công deepfake liên tục thay đổi. Tiến sĩ Kristen Moore từ CSIRO’s Data61, đồng tác giả nghiên cứu nêu rõ, thách thức lớn nhất mà những hệ thống phát hiện deepfake hiện nay gặp phải nằm ở khả năng học liên tục. Khi xuất hiện kiểu deepfake mới, cần phải huấn luyện lại mô hình từ đầu, dẫn đến việc “quên” một số dạng tấn công cũ. “Nếu chỉ tinh chỉnh mô hình với dữ liệu mới, nó sẽ mất đi khả năng nhận diện deepfake trước đó,” bà Kristen Moore nói.

Kỹ sư âm thanh đang làm việc trên phần chỉnh sửa âm thanh được hiển thị trên màn hình máy tính. Nguồn: RAIS.

RAIS giải quyết vấn đề bằng cách tự động chọn lọc, lưu trữ một tập nhỏ nhưng đa dạng mẫu âm thanh trong quá khứ, bao gồm cả những đặc trưng ẩn mà con người khó nhận ra. Nhờ vậy, hệ thống có thể học kiểu deepfake mới mà không quên kiểu cũ. RAIS sử dụng một mạng lưới phụ tạo nhãn bổ trợ (auxiliary labels) cho từng mẫu âm thanh. Các nhãn bổ trợ này giúp mô hình xác định tập dữ liệu đại diện phong phú hơn, thay vì chỉ gắn nhãn “thật” hoặc “giả”. Chính cách tiếp cận đa tầng đã giúp RAIS đạt hiệu quả vượt trội - với tỷ lệ lỗi trung bình chỉ 1,95% qua năm lần thử nghiệm, thấp hơn những phương pháp trước.

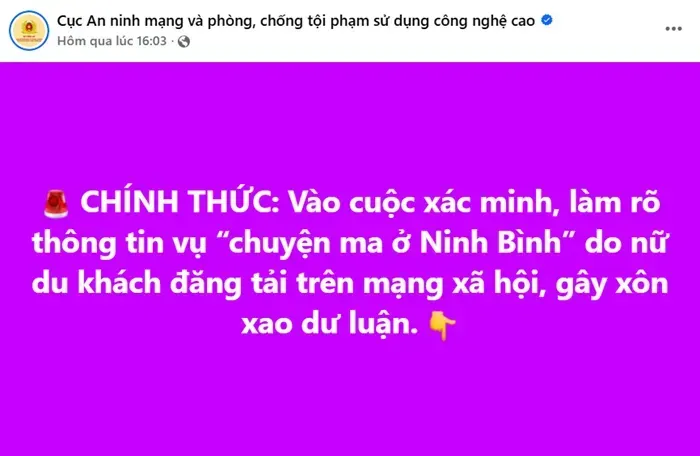

Theo tiến sĩ Falih Gozi Febrinanto, nghiên cứu sinh tiến sĩ tại Đại học Federation, “RAIS giúp mô hình vừa giữ lại những gì đã học, vừa thích ứng nhanh vừa giúp giảm thiểu nguy cơ “quên kiến thức” và nâng cao khả năng phát hiện deepfake”. Đáng chú ý, mã nguồn RAIS đã được công bố công khai trên GitHub, cho phép cộng đồng nghiên cứu, các tổ chức an ninh mạng ứng dụng rộng rãi. Nhóm nghiên cứu kỳ vọng RAIS sẽ trở thành tiêu chuẩn mới về hiệu quả, độ tin cậy trong lĩnh vực nhận diện giọng nói giả mạo, mở ra hướng đi bền vững đối với việc học máy liên tục (continual learning) ở kỷ nguyên AI vì hiện tại Deepfake đang được phản ánh tình trạng giả mạo khó lường.

Esther Vy